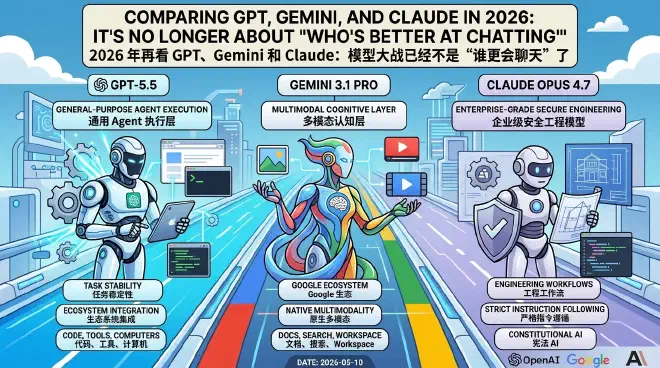

2026 年再看 GPT、Gemini 和 Claude:模型大战已经不是“谁更会聊天”了

Table of Contents

如果你还把 ChatGPT、Gemini、Claude 当成三个聊天机器人来比较,2026 年的 AI 世界大概会显得有点奇怪。

今天真正的竞争,已经不是“谁回答得更像人”,也不是“谁背的知识更多”。OpenAI GPT-5.5、Google Gemini 3.1 Pro 和 Anthropic Claude Opus 4.7 代表的,是三套越来越完整的 AI 工作系统:它们会读文本、看图片、理解长文档,能写代码、调用工具、操作浏览器,还试图接管一部分复杂的办公、工程和研究流程。

换句话说,模型大战已经从“聊天框里谁更聪明”,变成了“谁能更稳定地帮人完成真实任务”。

这篇文章基于 OpenAI、Google DeepMind 和 Anthropic 已公开的技术报告、系统卡、模型说明与发布材料,聊聊三家旗舰模型的差异:它们的架构到底公开了多少,训练和对齐方法有什么不同,分别适合什么应用,以及为什么产品入口比模型名字本身更重要。

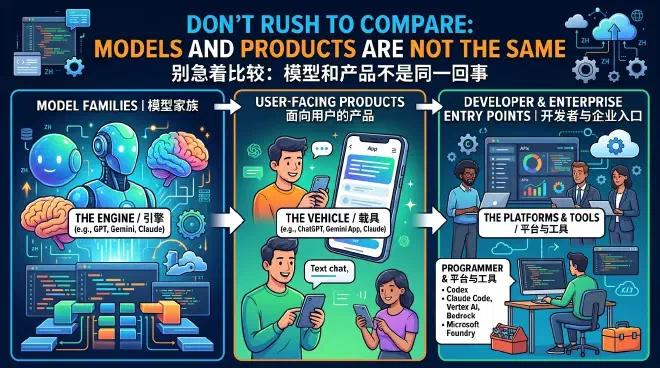

先别急着比较:模型和产品不是一回事 #

很多讨论一开始就会混在一起:GPT 是不是 ChatGPT?Gemini 是模型还是 App?Claude Code 和 Claude 又是什么关系?

一个比较不容易踩坑的理解是:

- GPT、Gemini、Claude 是模型家族。

- ChatGPT、Gemini App、Claude 是面向用户的产品。

- Codex、Claude Code、Vertex AI、Bedrock 这些,是模型进入开发者、企业和云平台的入口。

所以,如果我们说“GPT-5.5 很强”,严格来说是在说 OpenAI 的某个底层模型能力很强;如果我们说“ChatGPT 很好用”,则是在说模型、工具、文件能力、浏览器能力、UI、记忆、企业权限等一整套产品体验好用。

这点在 2026 年尤其重要。因为模型本身当然重要,但真正决定用户每天会不会打开它的,往往是产品层:它能不能连上你的文档?能不能读代码仓库?能不能跑测试?能不能把一个复杂任务拆开做完?能不能在企业环境里让安全团队点头?

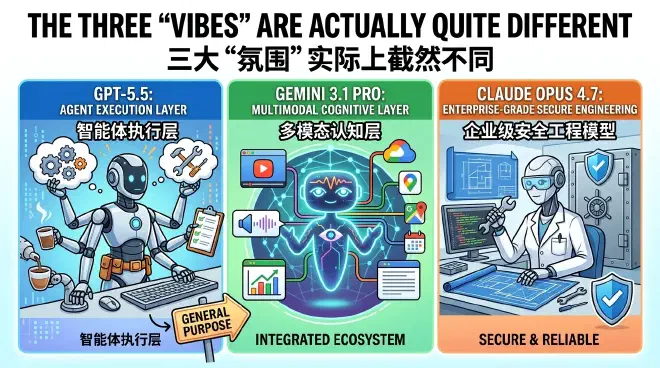

三家的气质其实很不一样 #

如果只用一句话概括:

GPT-5.5 像一个通用 Agent 执行层,Gemini 3.1 Pro 像 Google 生态里的多模态认知层,Claude Opus 4.7 像企业级安全工程模型。

OpenAI 的路线很明显:把 GPT 推向真实工作。GPT-5.5 的公开材料强调 coding、browser/tool use、computer use、knowledge work 和科研任务。它不只是回答“这段代码为什么错”,而是更接近“我来读仓库、改代码、跑测试、解释结果”。ChatGPT、Codex 和 API 共同组成了 OpenAI 的主战场。

Google Gemini 的优势则更像是“我有整个 Google 宇宙”。Gemini 从一开始就强调原生多模态,文本、图像、音频、视频、长上下文都是核心路线。到了 Gemini 3.1 Pro,这条路线和 Gemini App、Gemini API、Vertex AI、NotebookLM、Google Workspace、Android、Cloud 结合在一起,价值不只是模型本身,而是它能进入多少 Google 已经拥有的工作场景。

Anthropic Claude 的气质更克制,也更企业化。Claude Opus 4.7 的公开叙事重点是长程软件工程、严格指令遵循、高分辨率视觉、安全防护和 Claude Code/API 生态。它不一定要在每个消费级入口都刷存在感,但很适合那些“这个任务很长、很贵、很敏感,别给我乱来”的场景。

架构细节?别问,问就是保密 #

如果你关心底层架构,坏消息是:三家旗舰模型都非常保密。

Google 是三家里在历史技术报告中披露相对多的。Gemini 1.5 Pro 明确说过自己是基于 Mixture-of-Experts 的 sparse Transformer。简单说,MoE 就像一个专家团队:每个 token 不一定让全部参数都参与计算,而是通过路由机制调用部分“专家”。这可以在扩大总参数规模的同时,控制每次推理实际激活的计算量。

但到了 Gemini 3.1 Pro,Google 并没有把全部内部结构摊开。它公开的是能力、输入输出模态、上下文窗口、工具调用和产品入口,而不是参数量、专家数、路由策略或训练 token 数。

OpenAI 这边也类似。GPT-4 公开说是 Transformer-style model,GPT-4o 公开为 autoregressive omni model,GPT-5.5 公开了任务能力、安全系统卡、API 可用性和部分基础设施协同设计。但最让架构党好奇的东西,比如参数量、是否 MoE、训练计算量、数据比例、并行策略,官方都没有给出完整答案。

Anthropic 对 Claude Opus 4.7 的底层结构披露同样有限。官方更愿意谈能力、安全评估、上下文窗口、视觉能力、企业工作流和风险治理,而不是告诉你它到底是稠密模型还是稀疏专家模型。

所以,如果有人非常肯定地说“某某模型一定有多少参数”或者“某某旗舰一定用了某种 MoE 结构”,最好先问一句:官方来源在哪里?

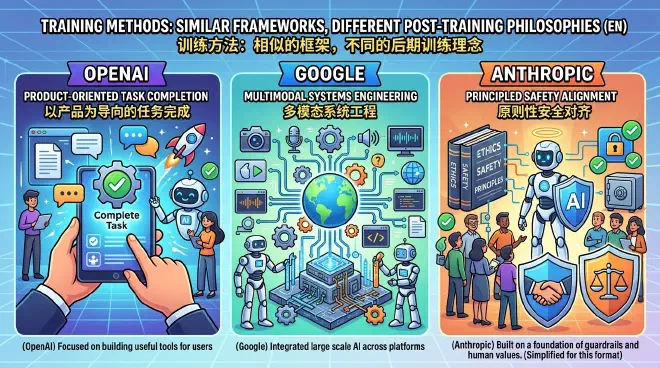

训练方法:骨架相似,后训练哲学不同 #

从公开材料看,三家的基础训练路线并没有玄学到完全不可理解。

底层骨架大概率都是 Transformer 系列。OpenAI 对 GPT-4 的说明最直接:基础模型通过预测文档中的下一个 token 来训练。GPT-4o 虽然扩展到文本、视觉、音频等 omni 形态,但仍属于自回归模型路线。Gemini 的公开材料没有总是用同样直白的语言描述 next-token prediction,但 Gemini 1.5 报告里大量使用 next-token、NLL、long-context prediction 等评估语言,整体仍是自回归 Transformer 家族。Claude Opus 4.7 的完整训练细节没有公开,但公开叙事也建立在大规模预训练、后训练对齐和长任务工具使用之上。

真正有意思的,是后训练和对齐。

OpenAI 的 RLHF 历史流程披露得最完整。InstructGPT 论文给过经典三步:先用人类示范做 supervised fine-tuning,再训练 reward model,最后用 PPO 这类强化学习方法优化模型行为。GPT-4、GPT-4o、GPT-5.5 的公开材料不再把所有工程细节摊开,但系统卡、Preparedness Framework 和 Model Spec 让人能看到它们如何处理安全、拒答、冲突指令、风险主题和产品层行为规范。

Google Gemini 的公开重点偏生产系统:多模态训练、长上下文、安全过滤、红队测试、企业治理。Gemini 1.5 报告中可以看到 instruction tuning、SFT、human preference data、RLHF 等要素,但 Google 没有把具体 PPO、DPO、RLAIF 或偏好优化实现讲得很细。

Anthropic 的标签最鲜明:Constitutional AI。它的核心想法是,不只是让人类给模型打分,还给模型一套原则,让模型依据原则自我批评、修订回答,再用 AI feedback 形成偏好信号。这就是 Anthropic 常说的 helpful、harmless、honest 路线。到了 Claude Opus 4.7,具体生产训练配方依然保密,但 Anthropic 公开得更多的是安全评估、行为可靠性、prompt injection 抵抗、Responsible Scaling Policy 和高风险场景防护。

所以,最简短的结论是:三家都做预训练和后训练;OpenAI 更像产品化任务完成路线,Google 更像多模态系统工程路线,Anthropic 更像原则式安全对齐路线。

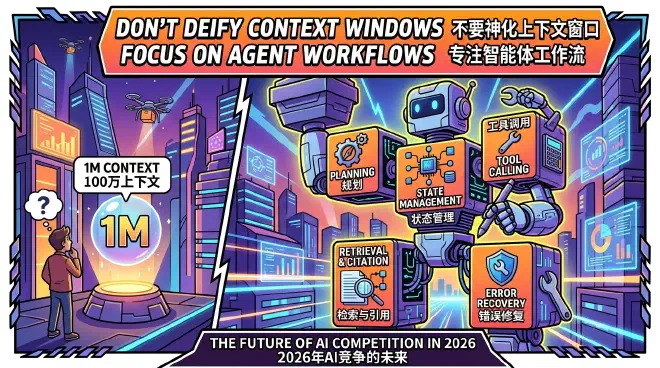

1M 上下文很厉害,但也别神化 #

2026 年旗舰模型还有一个共同关键词:超长上下文。

Gemini 3 Pro 模型页写到 1M 输入、64k 输出;GPT-5.5 API 也进入 1M 上下文;Claude Opus 4.7 官方页面同样写明 1M context window。看起来很壮观,好像终于可以把整个项目、整本书、整堆会议记录一次性扔给模型了。

这当然很有用。长上下文能让模型处理大型代码库、长报告、多文件合同、研究材料和跨模态内容。对工程、法律、咨询、科研、企业知识管理来说,这不是小升级。

但长上下文不等于长推理质量。能“塞进去”不代表能“理解好”,能找到 needle 不代表能完成复杂多步决策。一个模型可以拥有 1M 窗口,但在超长材料中仍然漏掉关键约束、混淆优先级,或者在后半段开始变得松散。

所以更现实的看法是:1M 上下文是基础设施门槛,不是终局答案。真正重要的是检索、引用、规划、工具调用、状态管理和错误恢复能力。这也是为什么 2026 年的竞争会越来越偏向 Agent 工作流,而不只是上下文窗口数字。

怎么选:别问谁最强,先问你要做什么 #

如果你主要写代码、调试、重构、处理工程自动化,GPT-5.5 和 Claude Opus 4.7 都是优先候选。GPT-5.5 的优势在于通用工具链、ChatGPT/Codex/API 的整合,以及面向真实工作任务的产品能力。Claude Opus 4.7 的优势在于长程软件工程、严格指令遵循和企业场景下的安全感。

如果你的任务大量涉及多模态、长文档、视频、音频、Google Workspace 或 Google Cloud,Gemini 3.1 Pro 的路线很有吸引力。它最自然的舞台不是孤立聊天框,而是 Google 生态里的文档、搜索、NotebookLM、Vertex AI 和云端工作流。

如果你在企业里做合规、风控、长任务审查、代码审查、严谨文本处理,Claude Opus 4.7 的定位非常清楚:少一点花哨,多一点稳。它的品牌叙事一直围绕安全对齐、可靠性和企业工作流展开。

如果你是个人用户,想要写作、数据分析、文件生成、日常办公和各种临时自动化,ChatGPT / GPT-5.5 仍然是最顺手的通用生产力入口之一。不是因为它在每个单点都绝对第一,而是因为产品层把很多能力揉在了一起。

真正的差异在产品形态里 #

很多人喜欢追问:“到底谁的模型架构更先进?”

这个问题当然重要,但公开资料目前无法给出完整答案。三家都没有公开足以复现旗舰模型训练的细节。参数量、训练 token 数、训练 FLOPs、优化器、学习率计划、并行切分策略,这些关键材料基本都在黑箱里。

我们能更稳妥判断的,是它们公开出来的设计取向:

- Gemini 更愿意讲模型家族、多模态、长上下文和系统工程。

- OpenAI 更愿意讲真实工作、工具使用、产品行为规范和安全系统卡。

- Anthropic 更愿意讲原则式对齐、长任务可靠性、企业安全和风险治理。

这背后其实是三种市场路线。

Google 要把 Gemini 放进它已经拥有的生态。OpenAI 要把 GPT 做成通用 Agent 和生产力入口。Anthropic 要让 Claude 成为企业信任的工程与知识工作伙伴。

到了 2026 年, AI 模型已经不像早期那样,只需要在聊天框里显得聪明。真正的竞争,是谁能把能力稳定地交付到复杂场景里:读一堆资料,理解上下文,调用工具,写代码,改文件,检查结果,遵守边界,然后把事情做完。

这也是为什么 GPT-5.5、Gemini 3.1 Pro 和 Claude Opus 4.7 的比较,最后不会落在一个简单排名上。

更像是三个答案:

- 想要通用 Agent 和生产力工作流,看 GPT-5.5 / ChatGPT / Codex。

- 想要多模态、长上下文和 Google 生态,看 Gemini 3.1 Pro。

- 想要长程工程、安全对齐和企业可靠性,看 Claude Opus 4.7。

别再问“谁更会聊天”了。2026 年的问题是:谁更能干活,谁更适合你的工作流,以及谁能在把活干完的同时别把事情搞复杂。