深度解码:大型语言模型如何“看见”结构?

·121 words·1 min

Table of Contents

从原生多模态到混合专家架构的效能飞跃 #

前言: 在企业实践中,我们常将大型语言模型(LLM)视为处理信息的“超级大脑”。然而,当面临错位的 Excel 报表、复杂的嵌套代码,或中英混排的技术文档时,不同模型表现出的稳定性差异,本质上源于其底层对“结构”理解方式的不同。

对于企业管理者和工程师而言,理解这些架构差异,是决定 AI 协作流效率与精度的关键。

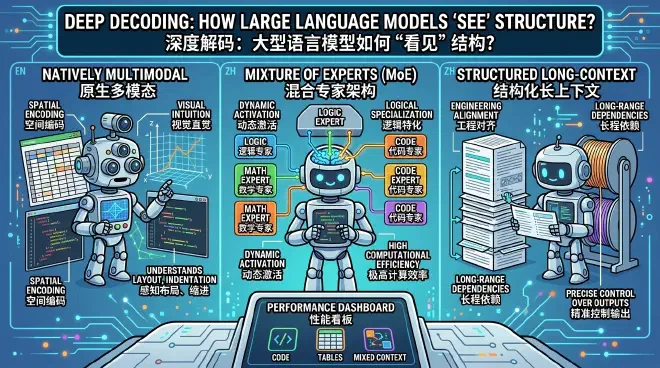

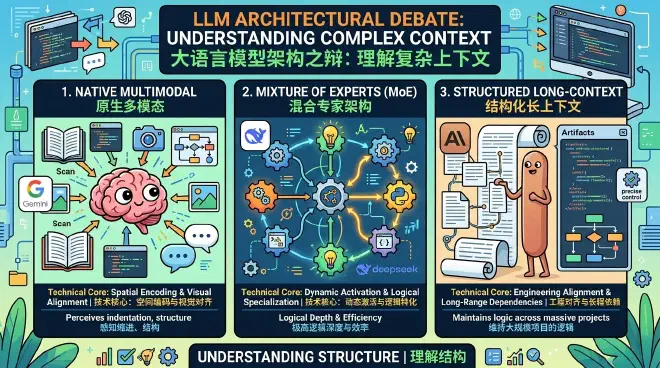

一、 核心架构之辩:模型如何理解复杂上下文? #

目前的顶级模型在处理多模态与混合语言时,主要采用了三种不同的技术路径:

1. 原生多模态架构(Natively Multimodal) #

- 技术核心:空间编码与视觉对齐(如 Google Gemini, GPT-4o)。

- 特征:在单一框架内集成视觉与语言模块,底层共享注意力权重。

- 优势:拥有“视觉直觉”。它不只是读文字,而是能感知缩进、换行和物理间距。面对混乱格式时,能像人类一样通过“扫视”理解空间的拓扑结构。

2. 混合专家架构(MoE) #

- 技术核心:动态激活与逻辑特化(如 DeepSeek)。

- 特征:采用稀疏激活机制,根据任务属性动态调用特定的专家神经元模块。

- 优势:极高的逻辑深度。在处理算法重构等高难度符号逻辑时,能以极高的计算效率维持逻辑一致性。

3. 结构化长上下文架构 #

- 技术核心:工程对齐与长程依赖(如 Claude 系列)。

- 特征:侧重于利用超长上下文窗口维持大规模项目的逻辑对齐。

- 优势:擅长“工程化对齐”。通过如 Artifacts 等功能,它展现出对代码、流程图等结构化输出的精准控制力。

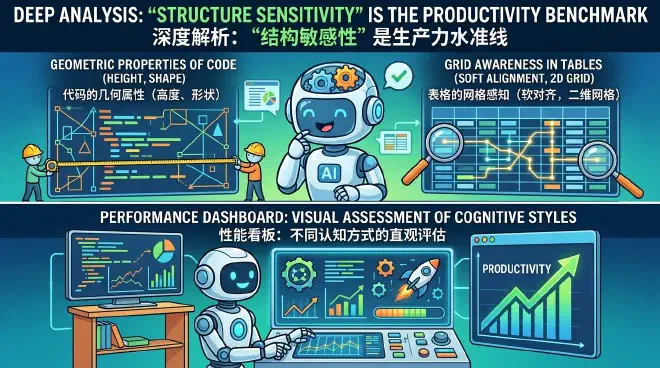

二、 深度解析:为什么“结构敏感性”是生产力水准线? #

企业数据往往包含大量非规则信息,信息的精髓不仅在于“文字”,更在于“布局”。

- 代码的几何属性:先进模型不再将代码视为线性字符流,而是将其理解为具有“高度”(缩进)和“形状”(括号)的几何符号。这使得模型能自然地捕捉代码块的包围感。

- 表格的网格感知:面对非对齐数据,多模态模型采用**“软对齐(Soft Alignment)”**机制。它将表格视为二维网格图像,通过捕捉单元格间的横纵几何关联,避免了因字符错位导致的逻辑断裂。

三、 性能看板:不同认知方式的直观评估 #

| 评估维度 | 混合专家架构 (MoE) | 结构化长上下文模型 | 原生多模态模型 |

|---|---|---|---|

| 典型代表 | DeepSeek | Claude | Gemini / GPT-4o |

| 代码理解 | 强符号逻辑推理 | 逻辑边界清晰,擅长引用 | 空间视觉特征感应 |

| 表格/文档 | 文本逻辑模式对齐 | 擅长跨文档复杂关联 | 二维空间特征编码 |

| 混合语境 | 优化分词器,衔接紧密 | 指令遵循度极高 | 捕捉物理临近性语义 |

四、 决策建议:如何更好地使用大模型辅助工作? #

1. 面向开发人员与工程师:按任务逻辑“选工具” #

- 算法重构与逻辑密集型任务:优先选用 MoE 架构模型,其动态专家机制在处理高难度算法 and 纯逻辑推理时具备深度优势。

- 大规模工程审计与系统分析:优先选用 长上下文架构模型,利用其对长程逻辑的掌控力进行整库分析。

- 处理格式损坏的代码或文档:优先选用 原生多模态模型。直接上传代码截图或 PDF 原件,效果往往优于纯文本录入,因为模型能利用视觉编码还原损坏的层级。

2. 特别提醒:安全合规与保密义务(开发者必读) #

在享受 AI 效率红利的同时,必须守住企业安全底线:

- 脱敏处理:严禁直接向公共 AI 平台上传包含商业机密、客户隐私数据或未公开的底层核心源代码。

- 本地化部署优先:对于高度敏感的代码审计或专利技术分析,应优先使用企业内部私有化部署的模型实例。

- 关闭训练反馈:在使用商用 AI 工具时,务必检查设置,确保已关闭“允许将输入数据用于改进模型训练”的选项。

3. 面向企业管理者:构建“异构智能体”协作体系 #

建立异构集群:避免用单一模型处理所有业务。应根据任务模态分发任务,例如将 PDF 解析交给原生多模态模型,将业务审查交给长上下文模型。

推行“结构优先”的提示工程(Prompt Engineering):

- 显式结构化:在指令中明确指明数据列的含义、边界和预期类型。

- 两步走策略:引导 AI “先重建结构,再进行后续分析”。

- 利用多模态输入:鼓励团队利用模型的多模态能力输入原始文件,以减少信息在文本转换中的丢失。

总结: 大模型的演进正从“读文字”向“感知布局”跨越。掌握架构差异并严守数据安全边界,将让 AI 真正进化为理解复杂工程环境的数字架构师。这种精准且安全的协作,将为您在 AI 转型中带来实质性的竞争力。