突破百万 Token 壁垒:DeepSeek-V4 的 5 个核心技术亮点

Table of Contents

多年来,大语言模型(LLM)一直受到一个基本数学约束的困扰:二次计算复杂度。随着对话变长或文档变得庞大,处理这些信息所需的资源不仅是线性增长,而是爆炸式增长。这种“二次方墙”正是大多数模型最终失去“记忆”的原因——当任务涉及分析数千行代码或维护复杂的跨天工作流时,它们会变得迟缓或语无伦次。

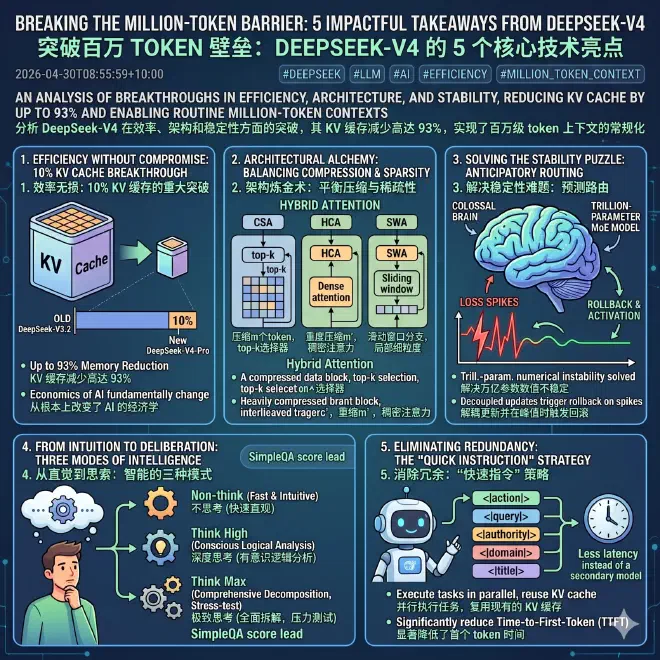

DeepSeek-V4 的出现是对这一效率障碍的一次精准打击。它包含两个主要架构:DeepSeek-V4-Pro(1.6 万亿参数的 MoE 模型,每个 token 激活 490 亿参数)和 DeepSeek-V4-Flash(2840 亿参数模型,每个 token 激活 130 亿参数)。这一系列模型旨在让百万 token 的上下文窗口成为常规标准,而非计算奢侈品。这些模型在 32 万亿(Flash)和 33 万亿(Pro)token 的海量数据上进行训练,代表了我们扩展智能方式的基础性转变。

1. 效率无损:10% KV 缓存的重大突破 #

在 AI 扩展的世界里,更大的上下文窗口通常意味着资源的指数级消耗。DeepSeek-V4 通过惊人地减少“键值(KV)缓存”——存储对话上下文所需的内存——改变了这一现状。

根据技术数据,在百万 token 的上下文中,DeepSeek-V4-Pro 与其前身 DeepSeek-V3.2 相比,仅需 27% 的单 token 推理 FLOPs(以等效 FP8 FLOPs 衡量),且仅需 10% 的 KV 缓存。对于更紧凑的 Flash 模型,数据更具颠覆性:其 KV 缓存需求仅为前代产品的 7%。

这种效率是反直觉的;通常,维持百万 token 的“活跃记忆”需要巨大且昂贵的硬件集群。通过将内存占用减少高达 93%,DeepSeek-V4 从根本上改变了 AI 的经济学。这不仅仅是为了省钱;这是能够“阅读”代码库的 AI 与能够作为持久智能体“生活”在其中的 AI 之间的本质区别。正如研究人员所指出的:

“这使我们能够常规地支持百万级 token 上下文,从而使长周期任务和进一步的推理端扩展(test-time scaling)变得更加可行……开启了百万长度上下文的新时代。”

2. 架构炼金术:平衡压缩与稀疏性 #

这一效率背后的秘诀在于一种“混合注意力”架构,它使用三个不同的支柱来处理信息。DeepSeek-V4 并非同等对待每个 token,而是通过交错设计来确保因果关系和上下文的完整性:

- 压缩稀疏注意力 (CSA):该机制将每 m 个 token 的 KV 缓存压缩为单个条目。然后它应用“top-k”选择器,意味着模型只关注最相关的压缩条目,而非整个历史。

- 重度压缩注意力 (HCA):这一支柱使用更激进的压缩率 (m’),但保持“稠密”注意力,确保模型不会丢失文档的宏观、高层上下文。

- 滑动窗口注意力 (SWA):为了防止模型破坏因果关系或丢失局部的细粒度依赖,使用了辅助的 SWA 分支。这确保了模型始终对最近的 token 有清晰的视野。

通过交错使用这些方法,模型在细粒度局部依赖与大规模跨文档分析之间取得了平衡。这种设计对于复杂的智能体工作流尤为出色,因为 AI 必须在遵循宏大长期计划的同时,记住海量文件中的具体技术细节。

3. 解决稳定性难题:预测路由 #

训练一个拥有 1.6 万亿参数的模型是一个波动的过程。万亿参数的专家混合(MoE)模型以“数值不稳定”著称——突然且不可预测的“损失峰值”(loss spikes)可能会在训练期间崩溃,浪费数周的算力。

DeepSeek-V4 通过“预测路由”(Anticipatory Routing)解决了这个问题。在标准的 MoE 模型中,模型骨干和决定使用哪些专家的“路由”网络是同步更新的。DeepSeek-V4 将这些更新解耦。在任何给定的训练步骤中,模型使用来自前一步骤的“历史”参数来计算路由索引。

至关重要的是,该系统包含一个自动检测机制,当发生损失峰值时,会触发短时间的回滚并专门激活预测路由。不稳定性消失后,系统会恢复到标准训练。这个巧妙的工程技巧使得在 33 万亿 token 上的大规模扩展得以顺利进行,且模型没有“崩溃”,确保了庞大的参数量转化为稳定、可靠的智能。

4. 从直觉到思索:智能的三种模式 #

DeepSeek-V4 中最实用的创新之一是能够按需扩展“推理努力”(reasoning effort)。智能并非千篇一律;DeepSeek-V4 将其正式分为三种不同的模式:

- Non-think (不思考):快速且直观,为日常例行任务设计。

- Think High (深度思考):针对复杂问题解决,进行有意识的逻辑分析。

- Think Max (极致思考):绝对的最大努力模式。它使用特定的系统提示,迫使模型全面拆解问题、严谨地压力测试逻辑,并记录每一个被拒绝的假设。

结果是显而易见的。在测试事实准确性的 SimpleQA 基准测试中,DeepSeek-V4-Pro-Max 达到了 57.9% 的分数,以 20 个百分点的惊人优势超越了现有的开源基准。虽然在某些类别中仍落后于 Gemini-3.1-Pro 等闭源领军者,但在特定的检索和学术长文本任务中,它已经匹配或超越了前沿模型。

5. 消除冗余:“快速指令”策略 #

传统上,当 AI 聊天机器人执行辅助任务时——比如决定是否搜索网页或生成标题——它需要一个单独的“预填充”(pre-fill)步骤,甚至需要一个次要的小模型。这增加了延迟并消耗了冗余资源。

DeepSeek-V4 引入了直接附加到输入序列的“快速指令”(Quick Instruction)特殊 token。这些 token 允许模型通过复用现有的 KV 缓存来并行执行任务。支持的 token 包括:

<|action|>:判断是否需要搜索。<|query|>:生成实际的搜索词。<|authority|>:对来源权威性的需求进行分类。<|domain|>:识别提示词的领域。<|title|>:生成简短的对话标题。

通过绕过预填充瓶颈,DeepSeek-V4 显著降低了“首个 token 时间”(TTFT)。用户会感觉到响应更快速、更流畅,因为模型不需要为每个辅助子任务从头开始。

结语:开源的前沿 #

DeepSeek-V4 代表了从“静态”模型向能够处理长周期智能体任务的“动态”系统的转变。通过打破效率壁垒,它重新定义了开源 AI 的可能性。我们正在走向一个“在线学习”和持久 AI 智能体成为常态而非例外的未来。

如果处理百万 token 的成本降低了 90%,且扩展到 1.6 万亿参数的架构稳定性已经得到解决,那么你终于准备好将哪些复杂问题交给 AI 了呢?